![이번 연구의 제1저자로 참여한 김상엽 박사가 지난 2월 19일부터 23일(현지 시간)까지 미국 샌프란시스코에서 개최된 국제고체회로설계학회(ISSCC)에서 시연하고 있다. [사진=과학기술정통부]](https://cdn.fortunekorea.co.kr/news/photo/202403/35414_25603_5641.jpg)

[WHY? 인간의 뇌 구조 및 기능을 본따서 만들었다.]

국내 연구진이 엔비디아 A100 대비 소모 전력은 625배, 칩 면적은 41배 작은 AI 반도체를 세계 최초로 개발했다.

과학기술정보통신부(이하 과기정통부)는 KAIST PIM반도체 연구센터와 인공지능반도체 대학원 유회준 교수 연구팀이 400밀리와트 초저전력을 소모하면서 0.4초 만에 GPT 등 거대 언어 모델(LLM)을 처리할 수 있는 인공지능 반도체인 '상보형-트랜스포머'를 삼성 28나노 공정을 통해 개발했다고 6일 밝혔다.

연구팀은 거대 언어 모델을 4.5mm x 4.5mm의 작은 AI 반도체 칩 한 개에 초저전력으로 구현하는 것에 성공했다. 이는 그동안 다량의 GPU와 250와트의 전력 소모를 통해 구현됐다.

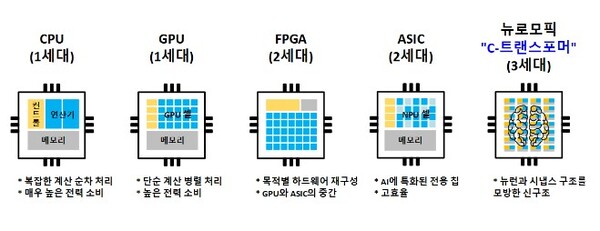

특히 인간의 뇌 동작을 모사하는 뉴로모픽 컴퓨팅 기술, 즉 스파이킹 뉴럴 네트워크(SNN)을 활용해 트랜스포머 동작을 구현한 것이 특징이다.

기존 뉴로모픽 컴퓨팅 기술은 합성곱신경망(CNN)에 비해 부정확하며 주로 간단한 이미지 분류 작업만 가능했다. 연구팀은 이것의 정확도를 CNN과 동일한 수준으로 끌어올리고, 다양한 응용 분야에 활용할 수 있는 상보형-심층신경망(C-DNN) 기술을 제안했다.

C-DNN은 심층 인공 신경망(DNN)과 SNN을 혼합 사용해, 입력 데이터들을 크기에 따라 서로 다른 신경망에 할당하여 전력을 최소화하는 기술이다.

사람의 뇌가 생각할 것이 많을 때 에너지 소모가 많고, 생각할 것이 적을 때 에너지 소모가 적은 것과 같은 원리이다. 뇌를 모방한 SNN은 입력값의 크기가 클 때는 전력을 많이 소모하고, 입력값의 크기가 작을 때에는 전력을 적게 소모한다. 지난해 연구팀은 이러한 특징을 활용해 SNN에는 작은 입력값만 할당하고, DNN에는 큰 값만 할당해 전력 소모를 최소화했다.

과기정통부는 "지난해 C-DNN 기술을 거대 언어 모델에 적용함으로써 초저전력·고성능의 온디바이스 AI가 가능하다는 것을 실제로 입증한 것"이라며 "그동안 이론적인 연구에 머물렀던 것을 세계 최초로 AI 반도체 형태로 구현했다"고 말했다.

특히 연구팀은 뉴로모픽 네트워크 기반 AI가 문장 생성, 번역, 요약 등과 같은 고도의 언어 처리 작업을 정확도 높게 수행할 수 있는지에 초점을 뒀다. 일반적으로 뉴로모픽 시스템은 에너지 효율은 높지만 복잡한 작업을 수행할 때 정확도가 떨어지는 경향이 있었다.

문제를 해결하기 위해 연구팀은 독창적인 DNN-to-SNN 등가변환기법을 개발해 적용했다. 이는 기존의 DNN 구조를 SNN로 변환하는 과정에서 정확도를 더욱 끌어올리기 위해 스파이크 발생 문턱값을 정밀 제어하는 방법이다. 연구팀은 "SNN의 에너지 효율성을 유지하면서도 DNN 수준의 정확도를 달성할 수 있었다"고 밝혔다.

또 전력 소모량을 GPU(NVIDIA A100) 대비 625배만큼 줄이면서, GPT-2 모델을 활용한 언어 생성은 0.4초 만에, T5 모델을 활용한 언어 번역은 0.2초 만에 고속 동작이 가능한 상보형 트랜스포머를 개발할 수 있게 됐다.

유회준 KAIST 전기및전자공학부 교수는 "이번 연구는 기존 AI 반도체의 전력 소모 문제를 해소했을 뿐 아니라, GPT-2와 같은 거대 언어 모델 응용에 성공했다는 점에서 큰 의의가 있다"며 "뉴로모픽 컴퓨팅은 초저전력·고성능 온디바이스AI의 핵심기술인만큼 앞으로도 관련 연구를 지속할 것"이라고 설명했다.

한편, 김상엽 박사가 제1저자로 참여한 이번 연구는 지난 2월 19일부터 23일까지 미국 샌프란시스코에서 개최된 국제고체회로설계학회(ISSCC)에서 발표 및 시연됐다.

상보형 트랜스포머 스파이킹 뉴럴 네트워크(SNN)와 심층 인공신경망(DNN)을 선택적으로 사용해 트랜스포머 기능을 구현한 기술.

뉴로모픽 컴퓨팅 인간의 뇌 구조 및 기능을 모방해 설계된 컴퓨팅 시스템. 뇌의 뉴런과 시냅스를 모방한 회로를 사용해 전통적인 컴퓨팅 시스템 대비 에너지 효율적으로 데이터를 처리할 수 있다.

스파이킹 뉴럴 네트워크(SNN) 뉴로모픽 컴퓨팅의 한 형태로, 뇌의 뉴런이 '스파이크'라는 시간에 따른 신호를 사용해 정보를 처리하는 방식. 생물학적 뇌의 작동 방식에 가까워 에너지 효율이 높고, 실시간 처리와 복잡한 시계열 데이터 분석에 적합하다.

합성곱신경망(CNN) 심층인공신경망의 한 형태로, 이미지 인식·비디오 분석·이미지 분류와 같은 시각적 데이터 처리에 사용되는 딥러닝 모델. 여러 인공 신경망 계층을 통해 이미지의 특징을 추출하거나, 이미지를 분류·인식하는 데 사용된다.

심층인공신경망(DNN) 여러 신경망 층으로 구성돼 복잡한 패턴을 인식하고 학습할 수 있는 AI 모델. 추상적인 특성을 계층적으로 학습하는 딥러닝에 사용된다.

포춘코리아 이세연 기자 mvdirector@fortunekorea.co.kr